Csírájában fojtja el a gyűlöletbeszédet a Facebook

Most először tette közzé átláthatósági jelentésében a gyűlöletbeszédre vonatkozó előfordulási mutatót a Facebook. A közösségi oldal a mesterséges intelligencia algoritmusokra támaszkodva mostanra elképesztő hatékonyan lép fel a kifogásolható tartalmakkal szemben.

Először tette közzé szokásos, negyedéves átláthatósági jelentésében az ún. gyűlöletbeszéd előfordulási mutató a Facebook. Az óriáscég az utóbbi időszakban láthatóan komoly erőfeszítéseket tesz annak érdekében, hogy a legnagyobb közösségi felületekre (így magára a Facebookra, vagy az Instagramra) kerülő tartalmak megfeleljenek a moderációs alapelveknek, így elsősorban jelentős fejlesztéseket hajtott végre az utóbbi időben a mesterséges intelligencia-alapú szűrőalgoritmusaiban.

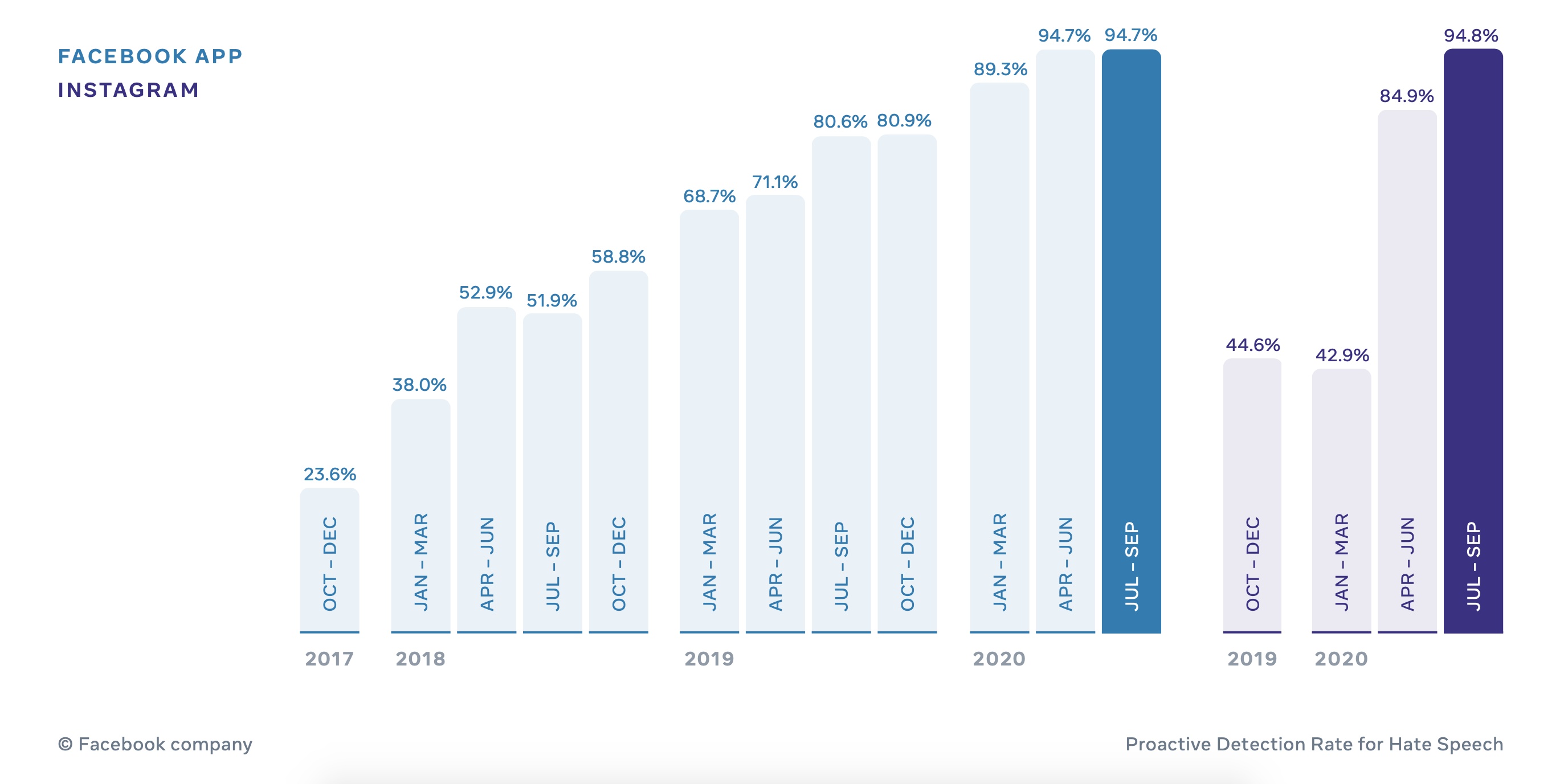

Ennek köszönhetően az idei harmadik negyedévben a gyűlöletbeszéd előfordulási (megjelenési) aránya 0,10-0,11% volt a fenti platformokon, vagyis tízezer tartalommegtekintésre 10-11 kifogásolható poszt jutott a statisztikák szerint. Az ominózus tartalmakat a Facebook automata algoritmusai és hús-vér moderátorai ma már szinte teljesen proaktívan, még azelőtt eltávolítják az oldalról, hogy bárki kifogást emelt volna ellenük - a legutóbbi negyedévben mind az Instagramon, mind a Facebookon 95% körül állt a proaktív beavatkozások aránya.

Jogod van tudni: mankó kirúgáshoz, munkahelyi szkanderezéshez Ezúttal egy mindenki számára kötelező, de laza jogi különkiadással jelentkezünk. Ennyi a minimum, amit munkavállalóként illik tudnod.

A rendszer alapvetően az egyre kifinomultabb mesterséges intelligencia algoritmusoknak köszönheti hatékonyságát, mely a sima, szöveges posztok mellett már a képi tartalmakat, illetve azok kontextusait is képes analizálni. A rendszernek azonban a cég saját bevallása szerint is vannak bizonyos korlátai, így az újabb trendekre, sztorikra alapuló gyűlöletbeszéd-formákat rendszerint meg kell tanítani az algoritmusnak, emellett nehézséget okoz a nyelvi és országspecifikus trendek beillesztése is.

Ad abszurdum számíthat az is, hogy a Facebook miként értelmezi a gyűlöletbeszédet, erre jó példa, hogy a holokauszttagadást csak múlt hónapban kezdte kategorikusan üldözni a szolgáltató.

A koronavírus világjárvány hatására a Facebook kénytelen volt minden korábbinál több esetben bevetni automata szűrőalgoritmusokat, miután a moderátorokat a legtöbb irodából hazaküldték, otthonról pedig érthető okokból nem volt biztosított számukra a teljes munkakörnyezet. A cégnek dolgozó moderátorok egyébként éppen a napokban írtak nyílt levelet a platform üzemeltetőinek, amiért foglalkoztatójuk a járványveszély érdemi csökkenése előtt visszarendelte őket az irodába.

A moderátorok szerint mindez a mesterséges intelligencia kudarcát mutatja. Ahogy fogalmaznak, az algoritmus lényegében vaktában tüzel, így fontos, az alapelveket egyáltalán nem sértő tartalmakat eltávolít, míg egyes, nemkívánatos posztokat átenged a szűrőn.