Google: nem fejezünk be minden katonai fejlesztést

Megjelentek a Google irányelvei a mesterséges intelligencia fejlesztésekkel kapcsolatban. Ezek szerint a fejlesztéseket a cég csak társadalmilag hasznos célokból vetné be, és kizárja belőle a fegyverkészítést. Katonai projektek viszont ettől még indulhatnak a jövőben is.

Hivatalos blogbejegyzésben tette közzé Sundar Pichai vezérigazgató a Google álláspontját a katonai fejlesztésekkel kapcsolatban, és ezzel együtt megjelentette a vállalat mesterséges intelligenciával kapcsolatos régen várt irányelveit is. A technológiai vállalatok társadalmi felelősségét is feszegető Project Maven egy hónappal ezelőtt kapott nagyobb nyilvánosságot a gépi tanulással foglalkozó szakértők sorozatos felmondása és egy petíció készítése miatt, amelynek több ezer aláírója a program lezárását követelte.

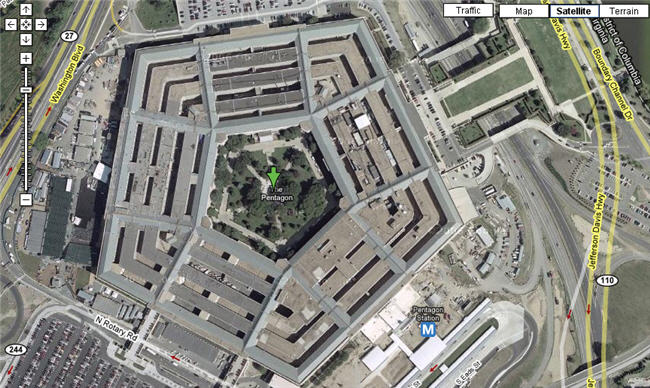

A projekt keretein belül ugyanis a fejlesztőknek különböző objektumok, például járművek helyét kellett automatizáltan meghatározni az amerikai katonai drónok felvételein, de a Google dolgozói azzal érveltek, hogy ilyen érzékeny kimenetelű, akár halált is okozó képelemzést nem szabadna az algoritmusokra bízni. Bár nem teljesen egyértelmű Pichai bejegyzése, de valószínűleg a híreszteléseknek megfelelően tényleg lezárja a vállalat a Mavent, viszont ahogy sejteni lehetett, nem fogja teljesen elengedni a sok megrendeléssel és nagy összegekkel kecsegtető katonai fejlesztéseket. A vezérigazgató viszont igyekezett leszögezni a közleményben, hogy mindezt nem fogják fegyverkezési célokra fordítani.

"(...) folytatni fogjuk a munkát a kormányzattal és a katonasággal sok más területen" - írja Pichai. Méghozzá ezek a területek a bejegyzés szerint a kibervédelem, a képzések, a toborzás, a veteránok egészségügye, a keresés és a megmentés. A Google vezérigazgatója szerint "ezek az együttműködések fontosak", ezért keresni fogják a lehetőségeket hogyan dolgozhatnak együtt a szervezetekkel "a szolgálat tagjai és a civilek biztonsága" érdekében. Egyébként a vállalat már a Mavennel kapcsolatban is igyekezett cáfolni, hogy magát a technológiát fegyverként lehetne használni, de a Google dolgozóinak érvei szerint a katonai projektek egyértelmű következménye, hogy a technológiát ilyen célokból is bevethetik. Ez a probléma pedig a további katonai projektek esetében is felmerülhet.

Hét irányelv

Már a katonai projekt hírének első felmerülésekor, februárban megígérte a Google az alkalmazottainak, hogy irányelvek szintjén szabályozza a mesterséges intelligencia fejlesztéseket, de erre végül csak most került sor. A dokumentum jelenleg összesen hét szempontot tartalmaz néhány mondatos kifejtésekkel. Ezek szerint a Google vonatkozó projektjeinek társadalmilag előnyös célokat kell szolgálni például az egészség, a biztonság vagy a közlekedés terén. Továbbá el kell kell kerülnie az elfogultság keltését vagy megerősítését akár fajok, etnikumok, nemek, nemzetek, jövedelem, szexuális orientáció, képesség, politikai vagy vallási hitek mentén.

Introvertáltak az IT-ban: a hard skill nem elég Már nem elég zárkózott zseninek lenni, aki egyedül old meg problémákat. Az 53. kraftie adásban az introverzióról beszélgettünk.

Mindezt pedig biztonságos körülmények közt kell fejleszteni és tesztelni, elszámoltathatóan az emberek felé, a személyes adatkezelés alapelveit, valamint a sztenderdeket és más tudományok szakértelmét figyelembe véve. A hetedik pont szerint pedig az elkészült fejlesztéseknek elérhetőnek kell lenniük a többi elv megvalósulása céljából, miközben a cég meggátolja, hogy a technológia potenciálisan veszélyt okozó alkalmazások számára is elérhető legyen. Egy projekt elfogadásakor a kiértékeléshez a Google figyelembe fogja venni, hogy a fejlesztendő alkalmazás milyen eséllyel használható károkozás céljából is, mennyire egyedi vagy általánosan elérhető, hogyan skálázódik, és a cégnek milyen szinten kell egyedi megoldásokat fejleszteni hozzá.

A szóban forgó katonai projektek miatt pedig az irányelv egy önálló alfejezetet is tartalmaz, amely szerint a Google nem fejleszt másoknak sérülést okozó technológiát, fegyvereket, "a nemzetközileg elfogadott normákat sértő" megfigyelési eszközöket vagy általában a nemzetközi joggal és az emberi jogokkal ellentétes mesterséges intelligencia megoldásokat.

Kétséges, hogy mennyire lesz elég a Google fejlesztői számára a részben rugalmasan értelmezhető szabályzat. Korábban a dolgozók nem csak ezeket az elveket hiányolták, hanem a nyílt beszélgetést is a Maven projekt elfogadásáról, és így sérelmezték megváltozott céges kultúrát. Most pedig Pichai egyértelműen közölte, hogy katonai projekt a jövőben is lesznek, ha sikerül újabb szerződést kötni, de nem tudni, hogy a fejlesztőket mennyire fogják ebben megnyugtatni a most közölt irányelvek. A Google már eddig is sok fontos szakembert vesztett és a botrány reputációs veszteséggel is járt, de úgy tűnik, hogy ennél fontosabbak a nagy bevételt hozó kormányzati és katonai projektek.