A YouTube az álhírek egyik legfőbb terjesztője

A YouTube arra rendezkedett be, hogy a felhasználókat minél inkább a felületen tartsa, nem pedig arra, hogy megbízható hírforrásokat ajánljon. A mérnökök problémába ütköztek a változtatással.

Nem csak a Facebook tereli a felhasználókat az álhírekhez, hanem a YouTube videóinak is nagy szerepe van ebben - mutat rá a The Wall Street Journal elemzése. A szerkesztők megfigyelése szerint a videós platform a legutóbbi algoritmus változtatások ellenére sem javult számottevő mértékben, miközben a Google keresőjében teljesen más, relevánsabb találatok jelennek meg ugyanazokra a keresőkifejezésekre. A videós platform még mindig azt a célt tartja szem előtt, hogy a látogatók az oldalon minél több időt töltsenek, így ajánlott videók formájában olyan tartalmat kínál, amelyek népszerűek az oldalon - ezek viszont erősen vitatható, megosztó vagy egyoldalú videók sokszor. A YouTube közlése szerint az oldalon töltött idő 70 százalékban az egymást követő ajánlásoknak köszönhető, napi 200 millió videót ajánl 80 különböző nyelven, így főleg az algoritmus dönti el a felhasználók lejátszási listáját.

Ezek a videók viszont az első néhány megbízható találat után nagyon hamar a félrevezető, megosztó, hamis nézeteket terjesztő tartalmakra kezdenek átváltani, még akkor is, ha ezek egyáltalán nem érdeklik a látogatót. A WSJ a tavaly novemberi és decemberi 40 legnépszerűbb keresőkifejezéssel vizsgálta meg a platformot, miközben kitörölte a profil előzményeit, hogy az algoritmust a korábban megtekintett videók ne befolyásolják. A törlés után a főoldalon tipikus szórakoztató videók jelennek meg több milliós nézőszámmal, de néhány keresés után már a kezdőoldalon is inkább összeesküvés-elméleteket taglaló, pártérdeket vagy propagandát szolgáló videók tűntek fel.

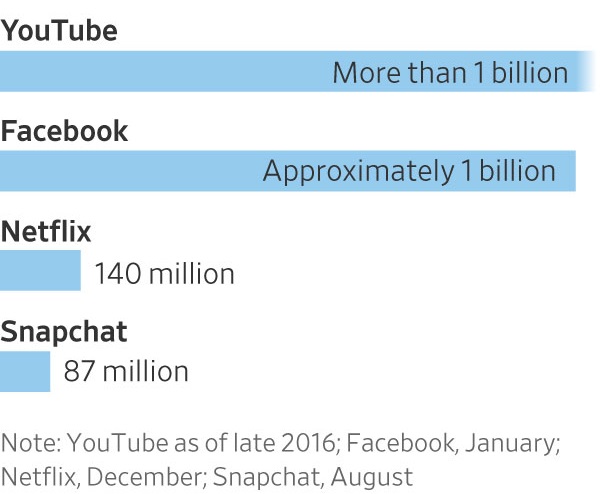

Napi oldalon töltött idő

A probléma azért is súlyos, mivel a YouTube egyre inkább a televízió szerepét igyekszik átvenni, már több mint 1,5 milliárd felhasználóval, akik napi szinten több mint 1 milliárd órányi tartalmat tekintenek meg a felületen. A fejlesztők bevallottan úgy alakították ki az algoritmust, hogy az a felhasználókat minél inkább marasztalja a kapcsolódó és sokat nézett videókkal. Márpedig a YouTube más közösségi oldalakkal ellentétben nem csak azt mutatja, ha valaki követ egy csatornát, hanem a kapcsolódó vagy ajánlott videókat feldobó algoritmusnak nagy szerepe van a videók megjelenítésében. A tartalomigazgatók csak az utóbbi időben kezdték a saját felelősségüket is megérezni az emberek hírfogyasztásában, legalábbis saját bevallásuk szerint.

Tavaly ősszel kezdte vizsgálni a YouTube, hogy milyen "irányadó" hírforrásokat lenne érdemes megmutatni a hírek keresésekor, és ennek alapján áttervezni a felületet. A továbbra is fennálló probléma miatt a WSJ kérdésére a fejlesztők elárulták, hogy az ajánlórendszerrel kihívásokba ütköztek, és tisztában vannak vele, hogy "ennél többet kell tenniük" - mondta Johanna Wright, az ajánlórendszerért felelős termékmenedzser. Az algoritmust ugyanis a kezdetekben úgy alakították ki, hogy minél inkább marasztalja a felhasználókat, és reklámokat mutasson a videók elején vagy közepén, és így termelje a pénzt.

Tehát az algoritmusnak korábban nem volt feladata a problémás videók kiszűrése, csak az eleve népszerű videók további ajánlása. Főleg 2016 óta, mikor a cég áttért egy mély neurális hálózatra, ami emberi közbeavatkozás nélkül összefűzi a videókat több száz jel alapján, amelyek közül a fő elem a korábban megtekintett videó. A WSJ felkérte a YouTube egyik korábbi mérnökét a népszerű keresőkifejezések alapján talált több ezer videó elemzésére, és a mérnök szerint a felhasználót tematikus lyukba szippantja az oldal, ha az első videó után rákattint egy ajánlásra, ami már provokatív nézeteket tartalmaz, és innentől egyre inkább félrevezető tartalmak következnek.

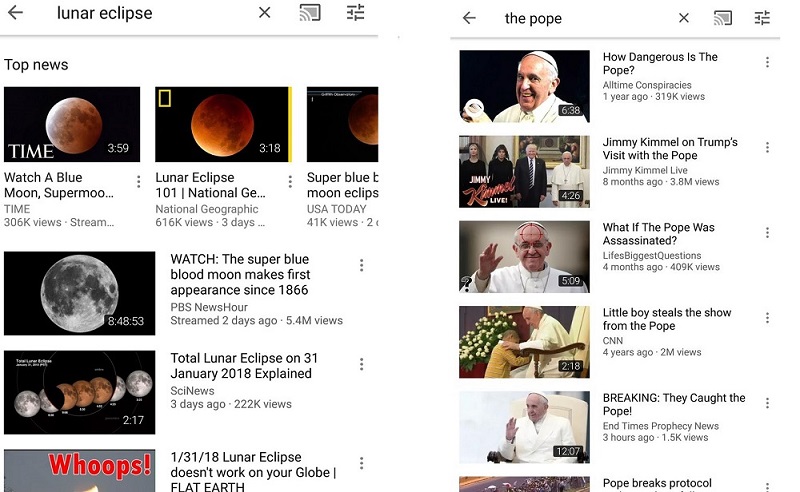

Két példa a keresésekre: hová vezet a holdfogyatkozásra és a pápára keresés?

Jogod van tudni: mankó kirúgáshoz, munkahelyi szkanderezéshez Ezúttal egy mindenki számára kötelező, de laza jogi különkiadással jelentkezünk. Ennyi a minimum, amit munkavállalóként illik tudnod.

Míg egy macskás videónál nem számít, hogy milyen lesz a következő macskás videó - addig egy hírnél vagy tudományos anyagnál fontos szempont, hogy a holdfogyatkozásról szóló videó után ne "a Föld lapos" "bizonyítás" következzen, amely egyébként 3 ezer megtekintéssel rendelkezik. Ugyanez igaz a vizsgálatban elemzett, pápáról, CIA-ról, FBI-ról, holdra-szállásról vagy influenza elleni védőoltásról szóló videókra, amelyek gyakran már a negyedik videó után konspirációs elméletekre váltanak át. Az ajánlórendszer azonban egyelőre nem különíti el a tematikákat, és ezért az algoritmus problémába ütközik a hírekkel és a politikai ajánlókkal - árulta el Cristos Goodrow, a YouTube ajánlórendszeréért felelős főmérnök.

Ezzel ellentétben a Google keresőmotorját eleve úgy tervezték a mérnökök, hogy az irányadó forrásokat jelenítse meg, ne csak a népszerű tartalmakat vizsgálja, ezért ugyanarra a keresőkifejezésre más jelenik meg a két felületen. A Google-nél csak a legfőbb híroldalak, addig a YouTube-on a fő találatok közt leginkább konspirációs elméletek szerepelnek, például az "FBI memo" kifejezésre. A Google szóvivője elmondta, hogy a kereső tavaly fejlesztett az algoritmuson, hogy releváns találatok jelenjenek meg, és most a mérnökeik együtt dolgoznak a YouTube csapatával a megoldáson. Viszont egy másik problémát az jelent, hogy a nagy események után a tartalomkészítők előbb kezdenek el írásos beszámolókat készíteni, mint videóban hitelesen elmondani a történteket. A helyzet tehát több szempontból is nehezen kezelhető, de a Google mérnökei jelenleg azon dolgoznak, hogy megoldják a problémát, és a népszerű videós platform se az álhírek terjesztését szolgálja a jobb nézettség érdekében.