Két új Tesla az Nvidiától

Új területet próbál becserkészni az Nvidia két új Tesla kártyájával. A két termék a gépi tanulásra fókuszál, melyeket egy szoftveres csomaggal próbál vonzóbbá tenni a vállalat.

Az Nvidia augusztusban, a GRID 2.0-val párhuzamosan jelentette be a szerverekbe szánt Tesla M60, illetve M6 gyorsítókat, melyeket a napokban két új megoldás követett. A nyár végén elrajtolt két modell a VDI (Virtual Desktop Infrastructure) és videokódolás felhasználási területeket célozta meg, míg az aktuális bejelentés tagjai elsősorban a deep learninghez és az adatközpontokhoz készültek.

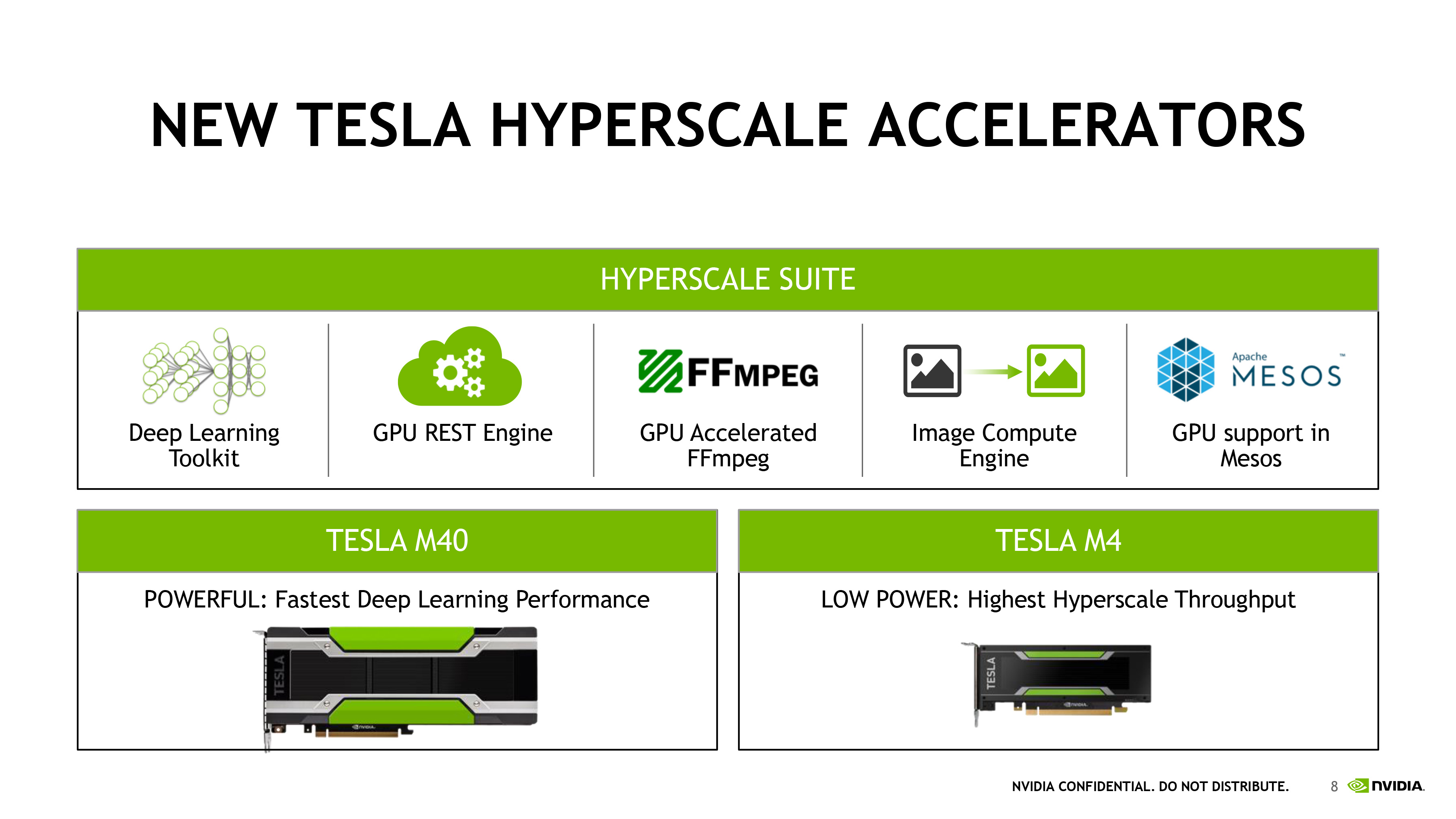

A most elrajtolt Tesla M40 és M4 kártyák az említett két modellhez hasonlóan már a Maxwell mikroarchitektúrára épülnek. Az Nvidia aktuális legújabb fejlesztése a dizájn sajátossá miatt alacsony dupla pontosságú tempóval rendelkezik, így HPC-re gyakorlatilag alkalmatlan. Ezzel szemben más felhasználási területekre még tökéletesen megfelel a Maxwell, melyek között például ott van a GPU-val jól gyorsítható gépi tanulás is.

Jogod van tudni: mankó kirúgáshoz, munkahelyi szkanderezéshez Ezúttal egy mindenki számára kötelező, de laza jogi különkiadással jelentkezünk. Ennyi a minimum, amit munkavállalóként illik tudnod.

Az M40 nevű nagyobbik modell az Nvidia zászlóshajó GPU-jára a GM200-ra épül. A 3072 végrehajtóegységet tartalmazó gigászi lapka egyszeres pontosság (FP32) mellett 7 teraflopsos tempóra képes. A kártyán található GDDR5-ös memória összkapacitása 12 GB, az általa biztosított sávszélesség 288 GB/s-os, míg a kártya TDP értéke 250 watt.

A kisebbik, M4 típusjelzésű termék low profile (alacsony profilú, vagy félmagas) kivitelű. A kártya áramkörén található GPU szerepét a GM206 kapta, melyben 1024 végrehajtó dolgozik, ami 2,2 teraflopsos egyszeres pontosságú számítási teljesítményt nyújt. A 88 GB/s-os sávszélességet biztosító memória kapacitás 4 GB, a TDP pedig 50 és 75 között konfigurálható.

Mindkét kártya a gépi tanulásra fókuszál, amire az Nvidia év eleje óta kiemelt figyelmet fordít. A vállalat szerint ez a következő olyan terület, ahol eljön majd a GPU-k térhódítása, a vállalat pedig egyből két termékkel szeretné itt megvetni a lábát. A kártyák alkalmasak, a többek között már a Google és a Facebook által is használt mély neurális hálózatok egyes művelteinek gyorsítására, melyek teljesítményének skálázása alapvetően nem egyszerű feladat.

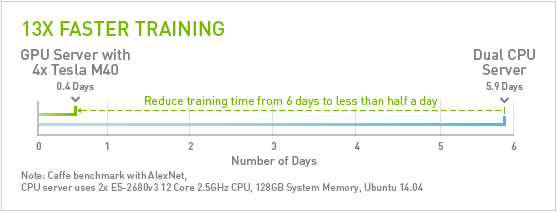

A két új Tesla az eltérő specifikációk miatt különböző feladatokra alkalmazható. Az erősebb M40 elsősorban a neurális hálózatok tanításának gyorsítására ajánlott, míg az M4 nevű kisebbik modell különböző gépi tanulási műveleteket végrehajtó sűrű klaszterekbe lehet jó választás. Felmerülhet a kérdés, hogy az ecsetelt feladatokra miért nem az erősebb, két GPU-val operáló Tesla M60-at ajánlja a cég. Ennek oka, hogy a gépi tanulás egyes feladatai, például a különféle tanítási algoritmusok nem skálázódnak jól a GPU-k számával.

A szoftver is fontos

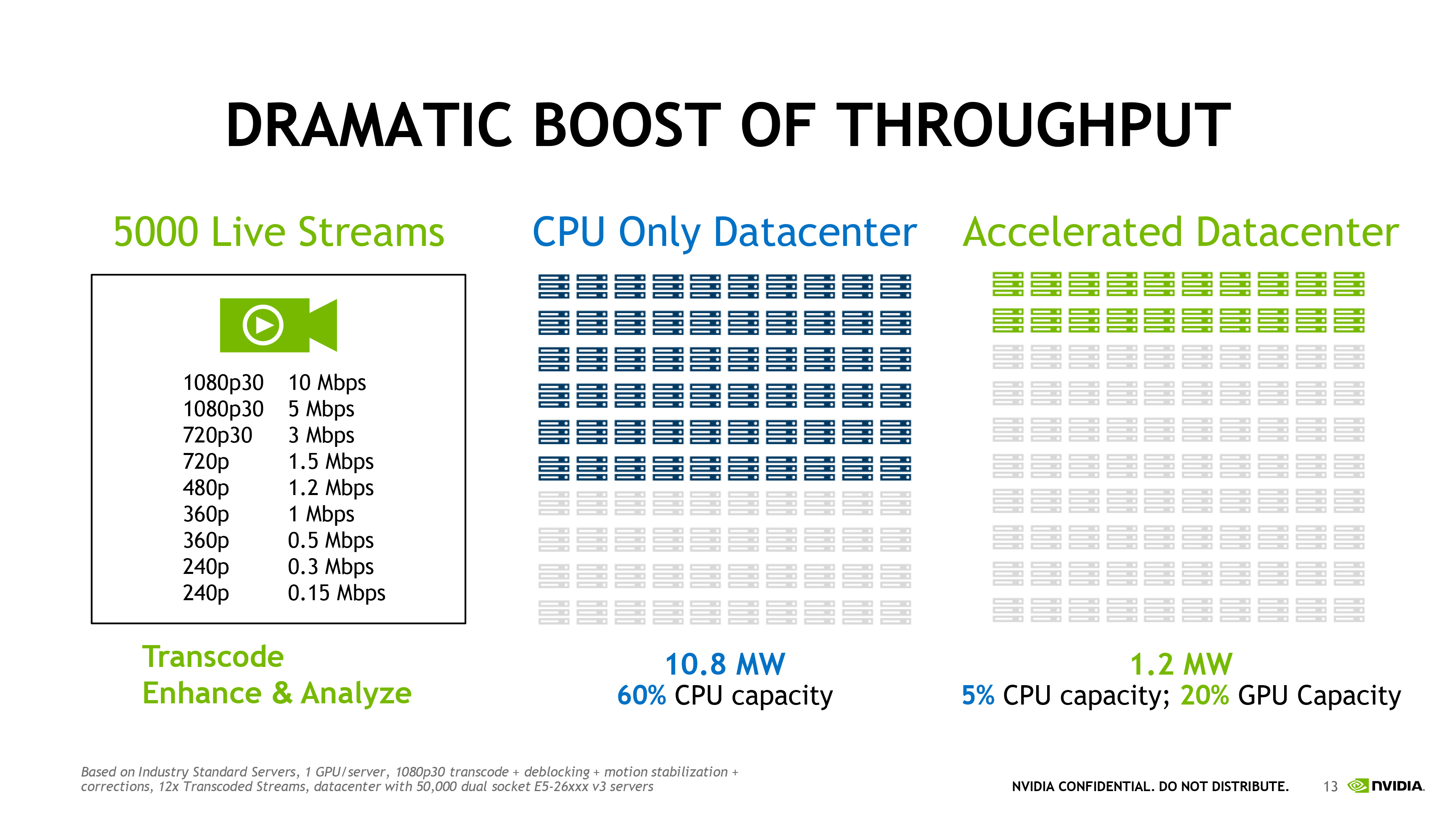

Az Nvidia a két Tesla mellé egy programcsomagot is készített. A Hyperscale Suite névre keresztelt szoftveres pakk legfontosabb része a GPU REST Engine, mely a GPU erőforrásaihoz biztosít a fejlesztők által is kihasználható API-t. A végeredménnyel például keresési műveletek, vagy képek osztályozása is gyorsítható. Utóbbihoz kapcsolódik még a NVIDIA Image Compute Engine, mellyel különféle képfájlok átméretezése végezhető el kevesebb idő alatt. Hab a tortán a cuDNN neurális hálózati szoftver, valamint az FFmpeg GPU-gyorsított verziója, mely utóbbi a GPU-ban található dekódoló és enkódoló blokk segítségével teszi tempósabbá a videók feldolgozását, illetve transzkódolását.

A Tesla M40, illtve a Hyperscale Suite még az idei évben elérhetővé válik, míg a Tesla M4 a következő esztendő első negyedévében kerül piacra.